ETL導入事例4選|課題別・業種別の活用パターンと定量効果を紹介

「ETLを導入したいが、自社の業種や課題に近い事例が見つからない」「他社がどんな効果を上げているのか、数字で確認したい」そう感じながら情報収集を続けている方は少なくないはずです。

ETL(Extract・Transform・Load)はデータ連携の自動化基盤として注目されていますが、製品の機能説明だけでは社内稟議を通すための判断材料として不十分なことが多いのが実情です。

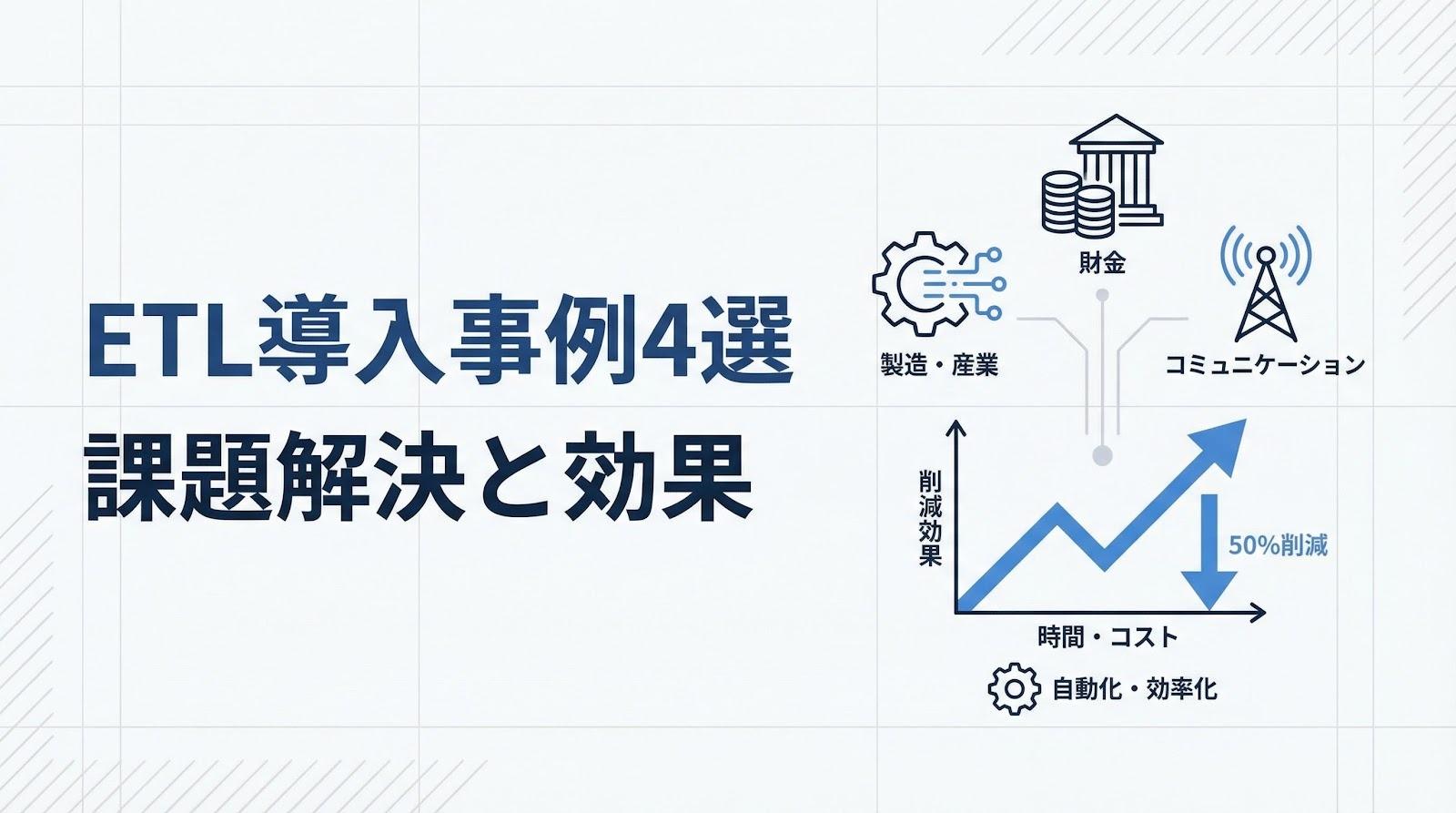

本記事では、製造業・金融業・情報通信業の実際の導入事例をもとに、課題別・業種別の活用パターンと定量効果を整理しています。

なお、データ統合の目的がマーケティングや顧客体験向上にある場合は、ETLツールに加えてCDPという選択肢も検討に値します。その点についても記事の後半で触れています。

ETLとは何か?事例を読む前に押さえる3つの基本プロセス

ETLの事例を正しく読み解くには、まず3つのステップが何をしているかを理解しておく必要があります。仕組みを知らずに事例を読むと、「どのステップで何が解決されたのか」が見えにくくなるためです。

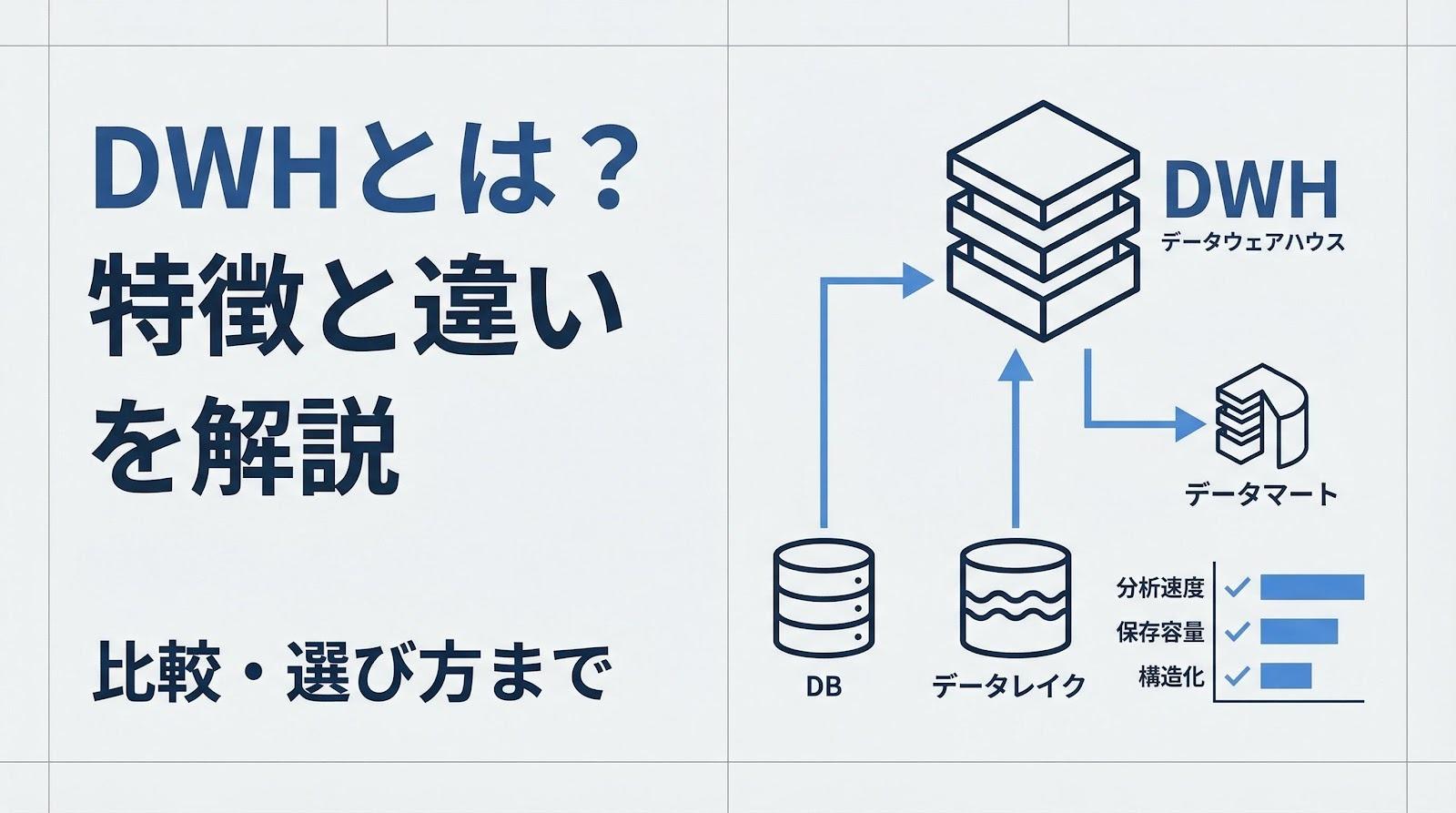

ETLとは、Extract(抽出)・Transform(変換)・Load(格納)の頭文字を取ったデータ処理プロセスです。複数のシステムに散在するデータを収集し、分析や業務に使える状態へ整えて、目的のデータベースやDWH(データウェアハウス)へ格納するまでの一連の流れを指します。

Extract(抽出)

基幹システム、SaaS、クラウドDB、ログファイルなど、異なる場所に存在するデータを取り出すステップです。データソースごとに接続方式や認証方法が異なるため、ここでの対応範囲がETLツール選定の重要な判断軸になります。

Transform(変換)

抽出したデータを、分析や業務で使える形に整えるステップです。文字コードの統一、日付フォーマットの変換、重複レコードの除去、複数テーブルの結合など、データの「クレンジング」と「加工」がここで行われます。りそなホールディングスの事例でも、メインフレームとオープン系システムが混在する環境での文字コード変換がこのステップに相当します。

Load(格納)

変換済みのデータを、DWH・データマート・BIツールなどの格納先へ書き込むステップです。差分更新か全件洗い替えか、バッチ処理かリアルタイム処理かといった設計がここで問われます。

手動やスクリプトでこの3ステップを実装することも技術的には可能ですが、データソースの仕様変更のたびにスクリプトの修正が必要になり、担当者への依存度が高まりやすい構造になります。ETLツールを導入することで、これらの処理をGUI上で設定・管理できるようになり、属人化の解消と運用の標準化が実現します。

ETLについて詳しく知りたい方はこちらの記事もご確認ください

ETL導入事例4選:業種・課題が異なる企業はどうデータ連携基盤を整えたか

ETLの導入効果は、抱えている課題と業種の文脈によって大きく異なります。データがサイロ化しているのか、レガシーシステムの刷新が急務なのか、あるいはリアルタイム処理の実現が必要なのか。課題の性質が違えば、選ぶツールも、得られる成果の出方も変わります。

ここでは、製造業・金融業・情報通信業の4社が、それぞれどのような文脈でETL・データ連携基盤の導入に至り、どんな成果を上げたかを整理します

アサヒグループジャパン株式会社(製造業:飲料・食品)

アサヒビール、アサヒ飲料、アサヒグループ食品などを統括するアサヒグループジャパンでは、グループ内で数百にのぼるシステムが個別に稼働し、密結合とデータのサイロ化が進んでいました。事業会社ごとにIT部門が存在し、それぞれが独自にシステムを運用してきた経緯から、データの利活用だけでなくシステムの維持管理や開発効率にも深刻な影響が出ていました

同社は既存環境にこだわらずフラットに複数ベンダーから提案を募り、数百システムを抱える大規模環境での将来像を共有できることを重視した結果、CTCが提案したインフォマティカ「Intelligent Data Management Cloud(IDMC)」を採用。

2024年7月にデータ連携基盤「アサヒデータコネクト」をリリースし、既存システムを8つのグループに分けて並行稼働しながら段階的に切り替えを進めています。

定量的な成果として、導入期間が従来の15ヶ月から10ヶ月へと5ヶ月短縮され、年間約1億円のコスト削減、システム運用保守工数の50%以上削減が報告されています。ノーコード/ローコード開発が可能なIDMCの特性を活かし、2029年をめどに全システムをアサヒデータコネクトへ連携させる計画です。

(出典:CTC導入事例https://www.ctc-g.co.jp/report/case-study/asahigroup-japan/)。

株式会社J-オイルミルズ(製造業:食品)

J-オイルミルズは、2004年に味の素製油、ホーネンコーポレーション、吉原製油の3社統合で誕生しました。統合時に各社の基幹システムを組み合わせる形でIT環境を整えましたが、約15年が経過し老朽化が顕在化。マスターデータの管理項目が不十分で、申請書を見ながら手作業で転記する運用が常態化するなど、全社的な生産性向上の足かせになっていました。

なお、J-オイルミルズの事例はETLツールの直接導入ではなく、MDM(マスターデータ管理)ソリューションの導入事例です。マスターデータの統一はETLパイプラインの品質を左右する前提条件であり、データ連携基盤整備の重要な構成要素として紹介しています。

全社DX基盤刷新の一環として、JSOLのマスターデータ管理ソリューション「J-MDM」を導入。基幹システムで利用するマスターデータを統一し、複数システム間で共通のマスターが利用可能な環境を整えました。申請・登録業務はワークフロー化され、マスターデータの更新がリアルタイムで各基幹システムに反映される体制になっています。

会計伝票類のほぼ全てがペーパーレス化され、会計データの可視化と多面的な収益管理が実現しました。こうしたデータドリブンな業務推進環境の整備が評価され、経済産業省の「DX認定事業者」に認定されています。製造業においてETLやデータ連携基盤を導入する際、マスターデータの統一は避けて通れない前提条件であり、J-オイルミルズの事例はその重要性を示しています。

(出典:JSOL導入事例 https://www.jsol.co.jp/casestudy/085_j-oilmills.html)。

株式会社りそなホールディングス(金融業)

りそなグループでは、約25年稼働していたメインフレームベースの情報系システムの老朽化が進み、オープン系基盤による「新情報系システム」への移行が進められました。メインフレームの勘定系システムとオープン系の各種業務システムが混在する環境で、多様なデータフォーマットへの対応や文字コード変換が必要という、技術的に複雑な要件がありました。

勘定系と業務システムをつなぐ「データハブ基盤」にHULFTおよびHULFT-DataMagicが採用され、文字コード変換を含むデータの抽出・加工・変換からデータベース連携までの一連のプロセスが自動化されました。

ミッションクリティカルな銀行システムのなかで、200GBのバッチデータを30分以内で伝送する性能を発揮し、1日のデータ総量は最大800GBにのぼります。

データ連携基盤の安定稼働を土台に、りそなグループはデータ分析の内製化も推進。顧客の閲覧履歴から特徴を把握し、適切なタイミングで金融商品を訴求する取り組みを進め、データサイエンスを活用した商品提案ではコンバージョンが倍増する実績を上げています。この事例からは、「接続先データソースの対応範囲」と「高信頼環境での連携実績」がETLツール選定の決め手になったことが読み取れます。

(出典:セゾンテクノロジー導入事例 https://www.saison-technology.com/casestudy/case-21/)

株式会社メルカリ(情報通信業)

メルカリでは、Kubernetesベースのマイクロサービス群から多種多様なデータを収集し、マーケティングや不正対策に活用しています。マイクロサービス間のデータ連携基盤としてApache Kafkaを採用し、Kafka ConnectによるCDC(Change Data Capture)を実装していましたが、自社でのKafka運用負荷が高く、リアルタイムでのデータ活用基盤の強化が課題でした。

2021年にKafkaのフルマネージドサービス「Confluent Cloud」を本番導入。運用コストを抑えつつ、豊富なコネクターを活用して複数のデータソースとシンクの組み合わせを柔軟に構築できるようになり、ニアリアルタイムのデータ連携要件にスピード感を持って対応できる体制が整いました。

従来10分ごとのバッチ処理だったデータ取得がリアルタイム化されたことで、不正検知の即時性が向上。マーケティング面でも、バッチ処理のタイミングで顧客へのインセンティブやクーポンが反映されない問題が解消され、最適なタイミングでの付与が実現しています。なお、Confluent Cloudはストリーミングデータ基盤であり、厳密にはETLツールとは異なります。データ連携の観点でETLプロセスに照らすと、Extract(抽出)とLoad(格納)のリアルタイム化に焦点を当てた取り組みとして位置づけられますが、Transform(変換)処理は別途実装されています。

(出典:Confluent顧客事例 https://www.confluent.io/ja-jp/customers/mercari/)。

ETL導入でどのような定量効果が得られるのか?

「どれくらい効果が出るのか」は、社内稟議を通すうえで最も聞かれる問いです。ただし、ETL導入の効果は業種・課題・データ規模によって幅があるため、自社に近い事例の数値を参照しながら期待値の範囲を把握することが現実的なアプローチです。ここでは前章で取り上げた事例から、工数削減・コスト削減・処理速度向上の実績を整理します。

工数削減の実績:50%以上の削減事例

工数削減の観点で最も明確な数値を示しているのが、アサヒグループジャパンの事例です。Informatica IDMC導入によりシステム運用保守工数を50%以上削減し、導入期間も15ヶ月から10ヶ月へ短縮しています。数百のシステムが密結合していた環境を疎結合化したことで、個別システムの変更が他システムへ波及するリスクが減り、保守対応の工数が大幅に圧縮されました。

りそなホールディングスの事例では、メインフレームとオープン系が混在する環境でのデータ連携・加工・変換プロセスをHULFT/HULFT-DataMagicで自動化。多様なデータフォーマットへの対応や文字コード変換といった、従来は手動対応が必要だった処理が自動化されたことで、担当者の手作業が大幅に削減されています。

工数削減の幅は、導入前の手動作業の多さと、連携するデータソースの数に比例する傾向があります。スクリプトで個別対応していた処理が多いほど、ETLツール導入による削減効果は大きくなります。

(出典:CTC導入事例https://www.ctc-g.co.jp/report/case-study/asahigroup-japan/)。

コスト削減・処理速度向上の実績

アサヒグループジャパンは、ETL基盤の導入により年間約1億円のコスト削減を実現しています。システムの疎結合化と標準機能の共有化が、個別開発・個別保守のコストを削減した主な要因です。

りそなホールディングスでは、新情報系システムへの移行後、1日で最大800GBにのぼるバッチデータを安定的に処理できるようになりました。データ分析の内製化を進めた結果、データサイエンスを活用した商品提案でコンバージョンが倍増する実績も上げています。

メルカリは、10分ごとのバッチ処理だったデータ取得をリアルタイム化しました。不正検知の即時性向上に加え、顧客へのインセンティブ付与のタイミング精度が上がり、マーケティング施策の効果が高まっています。

これらの数値は業種・規模・導入前の状態によって異なるため、そのまま自社に当てはめることはできません。ただし、「どの課題を解決したときにどの指標が改善したか」という対応関係は、稟議資料で期待効果を説明する際の参考になります。

(出典:JSOL導入事例 https://www.jsol.co.jp/casestudy/085_j-oilmills.html)。

(出典:セゾンテクノロジー導入事例 https://www.saison-technology.com/casestudy/case-21/)

(出典:Confluent顧客事例 https://www.confluent.io/ja-jp/customers/mercari/)。

(出典:CTC導入事例https://www.ctc-g.co.jp/report/case-study/asahigroup-japan/)。

自作スクリプトとETLツール導入の保守コスト比較

ETLツールの導入コストを検討する際、自作スクリプトとの比較は避けられない論点です。初期コストだけを見るとスクリプトの方が安く見えますが、運用フェーズに入ると状況が変わります。

自作スクリプトの保守コストが膨らむ主な要因は3つあります。まず、連携先のAPIやデータフォーマットが変更されるたびにスクリプトの修正が必要になること。次に、エラーが発生した際の原因調査と対応が担当者の属人的なスキルに依存すること。そして、担当者が異動・退職した際に引き継ぎコストが発生し、最悪の場合はスクリプトの再開発が必要になることです。

ETLツールを導入すると、これらの処理がGUI上で可視化・管理されるため、担当者が変わっても設定内容を確認しながら対応できます。エラー検知や再実行の仕組みも標準機能として備わっているツールが多く、障害対応の工数が削減されます。

ETLツールを活用する6つのメリット|ELTとの違いやデメリットも解説

費用対効果の損益分岐点は、主に「連携するデータソースの数」「連携頻度」「担当者の時間単価」の3要素で変わります。データソースが2〜3件程度でバッチ処理が月次程度であれば、スクリプトで十分なケースもあります。一方、データソースが10件を超え、日次・リアルタイムの連携が必要になってくると、ETLツールの導入コストを保守削減効果が上回る可能性が高まります。

ETL導入で確認すべきポイントとは?メリットや注意点、選定のポイントも解説

事例から導くETLツールの選定基準と導入時の注意点

事例を読んで「自社でも導入できそう」と感じたとき、次に直面するのがツール選定です。製品の数が多く、機能の差異もわかりにくいため、比較が進まないまま検討が止まるケースは珍しくありません。

ここでは、前章で取り上げた事例企業が何を重視してツールを選んだかを軸に、選定の判断基準を整理します。

事例から読み取れる4つの選定軸

前章の4社の事例を横断すると、ETLツール選定の判断軸は大きく4つに整理できます。

1つ目は「接続先データソースの対応範囲(コネクタ数・対応プロトコル)」です。りそなホールディングスの事例では、メインフレームとオープン系という異なるアーキテクチャへの対応が必須条件でした。自社が連携すべきデータソースの種類と数を棚卸しし、候補ツールの対応範囲と照合することが出発点になります。

2つ目は「操作性とノーコード/ローコード対応」です。アサヒグループジャパンがInformatica IDMCを選んだ背景には、数百システムを抱える大規模環境での実績に加え、ノーコード/ローコード開発への対応がありました。IT部門だけでなく業務部門のメンバーも設定・変更に関われる環境を作れるかどうかが、属人化解消の鍵になります。

3つ目は「既存DWH・BIとの連携実績とサポート体制」です。りそなホールディングスの事例では、金融機関の勘定系という高信頼性が求められる環境での稼働実績が重視されています。メルカリの事例でも、BigQueryやKubernetes環境との親和性がConfluent Cloud採用の判断材料になっています。

4つ目は「料金体系と自社規模との適合性」です。データ転送量課金・コネクタ数課金・ユーザー数課金など、ツールによって課金モデルが異なります。初期の見積もりでは安く見えても、データ量や連携先が増えるにつれてコストが跳ね上がるケースがあるため、将来の拡張計画を踏まえた試算が必要です。

導入失敗を避けるための進め方

導入失敗のパターンとして多いのは、最初から全社展開を目指して要件を広げすぎることです。アサヒグループジャパンが既存システムを8グループに分けて段階的に切り替えを進めているように、スモールスタートで1〜2件のデータ連携から始め、効果を定量化してから段階的に拡張する進め方が、リスクを抑えながら社内の理解を得やすい方法です。

なお、上記4軸はあくまでデータ連携の自動化・効率化を主目的とした場合の選定基準です。顧客データの統合・分析・施策実行を一気通貫で行うことが目的であれば、ETLツールとは別に、CDP(カスタマーデータプラットフォーム)という選択肢も検討に値します。

たとえばGENIEE CDPは、ノーコードで複数データソースを集約できるデータ連携機能に加え、AIによる分析サポートやMAツールへのセグメント連携まで備えており、「データを動かす」だけでなく「データを使って施策を打つ」ところまで対応しています。社内に分析専門家がいない場合や、データ活用の目的がマーケティング高度化にある場合は、こうした基盤の活用も選択肢のひとつです。

まとめ

本記事では、ETLの基本プロセスを起点に、課題別・業種別の導入事例と定量効果、そしてツール選定の4軸を整理してきました。

ETL導入を検討する際に最初に確認すべきことは、「自社の課題がどのパターンに近いか」です。データがサイロ化しているのか、手作業の工数が問題なのか、担当者への属人化が懸念なのか。課題を特定できれば、本記事の事例から参照すべき数値と選定基準の優先順位が自然と絞られます。

データのサイロ化により企業が被る損失とCDP活用による解決策

データ統合の目的がマーケティングや顧客体験の向上にある場合は、ETLツールだけでなく、顧客データの統合・分析・施策実行を一気通貫で扱えるCDP(カスタマーデータプラットフォーム)という選択肢も検討に値します。

CDPとDWHの違いとは?それぞれの機能や活用方法まで徹底解説

GENIEE CDPは、複数データソースのノーコード集約から、AIを活用した分析、MAツールへのセグメント連携まで一気通貫で対応しています。ジーニーのマーケティングクラウド製品群とシームレスに連携できるため、統合したデータをそのまま施策実行につなげられる点が特徴です。スモールスタートから始め、将来的にAI分析やパーソナライズ施策へ段階的に拡張していくことも可能です。データ活用基盤の構成を検討している場合は、あわせて参考にしてください。