信頼できるデータ基盤が創出する生成AIの価値最大化

この記事で分かること

- 生成AI活用における信頼できるデータ基盤の重要性と構築方法

- クラウドデータプラットフォームとAIサービスの統合による価値創出の実例

- 生成AIの代表的なユースケースと産業別の具体的な活用シーン

- AIエージェントによる自律的な業務プロセスの実現とその進化

- データ戦略とAI戦略を統合した企業変革の成功ポイント

はじめに – 生成AI時代におけるデータ基盤の重要性

生成AI(Generative AI)の急速な普及により、企業のビジネス環境は大きな変革期を迎えています。チャットボットによる顧客対応、コンテンツ生成、コード生成など、生成AIの活用範囲は日々拡大しており、多くの企業がこの技術を競争優位性の源泉として位置づけています。

しかし、生成AIの真の価値を引き出すためには、単に最新のAIモデルを導入するだけでは不十分です。生成AIアプリケーションの品質と信頼性は、その基盤となるデータの品質に大きく依存するのです。

不正確なデータ、古いデータ、バラバラに散らばったデータ、適切に管理されていないデータを使用した場合、AIが生成する結果も信頼性に欠けるものとなり、ビジネス上の誤った意思決定につながる可能性があります。ここがAIエージェントが回答する情報の精度に直結するということは実はまだ良く知られてはおりません。

このような背景から、「信頼できるデータ基盤」の構築が、生成AI活用の成否を分ける重要な要素となっています。

データの収集、保存、処理、ガバナンス、セキュリティを包括的に管理できる基盤を整備することで、企業は生成AIの価値を最大限に引き出すことができます。

本記事では、信頼できるデータ基盤がどのように生成AIの価値を生み出すのか、そして企業がどのようにこの基盤を構築すべきかについて、詳しく解説します。

信頼できるAIのための信頼できるデータ基盤の重要性

AX時代に最適なデータ基盤に求められる3つの要素

ついこの間までDX化の波の時代到来と言われていた時代はもはや一昔前。時代はAX(AIトランスフォーメーション)へと進化しています。

企業はいかにしてAIを企業活動の中で取り入れ生産性を向上させていくのか。これがもはや全産業の中で生き残っていくために必須となる要素であり考え方となります。

AX時代に求められる生成AI時代のデータ基盤には、3つの重要な要素が求められます。

第一に「ビジネス現場での使いやすさ」「データの民主化」です。

多機能かつ運用負荷の低いフルマネージド型プラットフォームにより、データエンジニアだけでなく、ビジネスユーザーも容易にデータを活用できる環境が必要です。複雑な設定や運用作業に時間を取られることなく、データ活用そのものに集中できることが重要です。

第二に「連携柔軟性」です。

強力なデータシェアリング機能により、組織内外のステークホルダーとシームレスにデータを共有し、コラボレーションを促進できることが求められます。データサイロを解消し、部門を超えたデータ活用を実現することで、組織全体でのデータドリブンな意思決定が可能になります。

第三に「信頼性」「データガバナンス」です。

エンタープライズ対応のセキュリティ、ガバナンス、可用性を備えることで、企業の重要なデータを安全に管理し、コンプライアンス要件を満たすことができます。データへのアクセス制御、監査ログの記録、データの暗号化など、包括的なセキュリティ対策が生成AI活用の前提条件となります。

クラウドプラットフォームとの統合

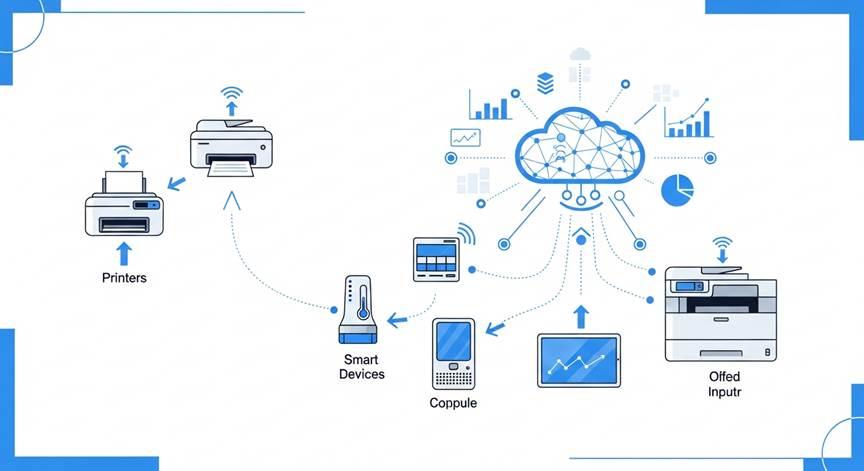

現代のデータ基盤は、クラウドプラットフォームとの深い統合が不可欠です。

主要なクラウドプラットフォームとの統合により、多数のサービスとシームレスに連携し、複数のリージョンにデプロイすることで、グローバルな事業展開にも対応できます。

実際、先進的な企業では、数千社以上の共同顧客が存在し、データ基盤とクラウドサービスの統合による価値創出が実証されています。

データ取り込みから、ETL処理、ガバナンス、ワークフロー管理、データサイエンス、機械学習、生成AIまで、一連のデータパイプラインをクラウド上で構築できることが、現代のデータ基盤の強みです。

IoTデータの収集、データレイクの構築、ダッシュボードやBIツールとの連携、さらにはコンテナベースのアプリケーション開発まで、包括的なエコシステムが整備されています。

構造化・半構造化・非構造化データのAI(RAG)READY対応

生成AI活用において特に重要なのが、多様なデータ形式への対応です。従来の構造化データ(リレーショナルデータベースのテーブルデータなど)に加えて、半構造化データ(JSON、XMLなど)、非構造化データ(テキスト、画像、音声、動画など)を統合的に扱える基盤が求められます。

特に生成AIアプリケーションでは、ドキュメント、音声、画像などの非構造化データを活用するケースが増えています。

これらのデータを効率的に処理し、ベクトル化してAIモデルに入力できる仕組みが必要です。ドキュメントAI、埋め込みモデル、検索機能などを統合したプラットフォームにより、非構造化データからも価値を引き出すことが可能になります。AIに最適化されたデータへの変換。つまり「AI READY」「RAG READY」なデータ基盤構築がAIエージェントの性能を最大化させるキーファクターとなります。

【参考情報】

CDP/DWHを活用したデータドリブン経営の実現にご興味がある方は、詳細はこちらの製品サイトをご覧ください

生成AIの代表的なユースケース

生成AIは、企業のあらゆる領域で活用が進んでいます。ここでは、特に効果が実証されている代表的なユースケースを3つの観点から解説します。

顧客体験の向上

顧客接点における生成AI活用は、最も早く成果が現れる領域の一つです。チャットボットやバーチャルアシスタントにより、24時間365日の顧客対応が可能になり、顧客満足度の向上とサポートコストの削減を同時に実現できます。

単純な問い合わせ対応だけでなく、顧客の過去の行動履歴や購買データを分析し、パーソナライズされた提案を行うことも可能です。

また、商談やコールセンターなどでの顧客や消費者との会話履歴分析により、顧客の声から潜在的なニーズや課題を抽出し、製品開発やサービス改善に活かすこともできます。コールセンターの通話記録やチャットログを自動的に分析し、顧客満足度の低下要因や改善機会を特定することで、プロアクティブな顧客体験の向上が実現します。

従業員の生産性と創造性の向上

社内業務における生成AI活用も大きな効果を生んでいます。Faqシステムでは対話型検索により、膨大な社内ドキュメントから必要な情報を瞬時に見つけ出すことができ、情報検索にかかる時間を大幅に削減できます。

また、SFAとの連携などによる商談や会議の自動議事録化や報告書の要約を自動生成することで、営業マンや従業員の生産性は格段にあがり、本来のコア業務に集中できるようになります。

コンテンツ生成やコード生成の分野でも、生成AIは大きな価値を発揮します。マーケティング資料の作成、プレゼンテーション資料の下書き、ソフトウェア開発におけるコードの自動生成など、クリエイティブな作業を支援することで、従業員の創造性を解放します。単純作業から解放された従業員は、より高度な判断や戦略的な思考に時間を割けるようになります。

ビジネスプロセスの最適化

バックオフィス業務における生成AI活用も注目されています。ドキュメント処理の自動化により、請求書、契約書、申請書などの処理時間を大幅に短縮できます。OCR技術と生成AIを組み合わせることで、紙の書類やPDFから情報を抽出し、自動的にシステムに入力することが可能になります。

また、データ拡張や不正検知の分野でも生成AIは活躍します。限られたデータから合成データを生成し、機械学習モデルの学習データを拡充したり、異常なパターンを検出して不正取引や不正アクセスを防止したりすることができます。サプライチェーンの最適化では、需要予測の精度向上や在庫管理の効率化により、コスト削減と顧客満足度向上を両立できます。

AIエージェントによる自律的な業務プロセスの実現

従来の機械学習から生成AI、そしてAIエージェントへ

AI技術の進化は、従来の機械学習から生成AIアシスタント、生成AIエージェント、そしてAgentic AIシステムへと段階的に発展しています。この進化の過程で、人間による監視の必要性は徐々に減少し、AIの自律性が高まっています。

従来の機械学習では、事前定義されたルールに基づいて分析タスクを実行し、限定的な適応力しか持ちませんでした。生成AIアシスタントの段階では、新しいコンテンツの生成が可能になり、限定的ながら意思決定を支援できるようになりました。さらに進化した生成AIエージェントは、単なるタスクではなく、より高度な目的を達成できます。

そして最新のAgentic AIシステムでは、自律的な意思決定と高い適応力を備え、人間の介入を最小限に抑えながら複雑な業務プロセスを遂行できます。新しいプロトコル(MCPなど)により、異なるシステム間での連携も容易になり、エンタープライズ環境での実用性が大幅に向上しています。

産業別の生成AI活用事例

生成AIとAIエージェントの活用は、業界ごとに特有のユースケースが生まれています。

例えば、金融業界では、投資調査アシスタントによる市場分析の自動化、保険引受の最適化による審査時間の短縮、インテリジェントな顧客体験の提供による顧客満足度向上が実現しています。

製造業では、研究インテリジェンスと発見による新製品開発の加速、保守管理の効率化による設備稼働率の向上、サプライチェーンの最適化によるコスト削減が進んでいます。

小売・消費財業界では、アメリカでは既にショッピングAI(※)の台頭が加速しており、AIショッピングアシスタントによるパーソナライズされた購買体験、サプライチェーンの再配分による在庫最適化、AI駆動の価格設定による収益最大化などが既に実現しています。

ヘルスケア・ライフサイエンス業界では、臨床ワークフローの自動化による医療従事者の負担軽減、事前承認の自動化による患者の待ち時間短縮、患者や会員とのエンゲージメント向上による治療効果の改善が報告されています。

このように、各業界の特性に応じた生成AI活用により、業務効率化と顧客価値向上の両立が実現しています。

参照元:日本経済新聞

【関連情報】

AI基盤の比較検討にお役立ていただける資料をご用意しています。詳しくはこちらのホワイトペーパーをご覧ください

生成AIアプリケーション開発のための統合プラットフォーム

データとAIの統合による価値創出

生成AIアプリケーションの開発には、データプラットフォームとAIサービスのシームレスな統合が不可欠です。主要なアプローチとして、4つの統合パターンが確立されています。

第一に、データプラットフォームのデータを使用した大規模言語モデル(LLM)の実行です。

シームレスに接続し、データに対して高いセキュリティとガバナンスを維持しながら、クラウドAIサービスの豊富な基盤モデルを活用できます。データを外部に持ち出すことなく、セキュアな環境でAIモデルを実行できることが重要です。

第二に、カスタムモデルの構築とファインチューニングです。

データプラットフォームと機械学習サービス間のネイティブデータコネクターを活用して、データを使って自社のモデルを構築あるいはファインチューニングできます。

業界特有の用語や企業固有のビジネスロジックを学習させることで、汎用モデルよりも高精度な予測や生成が可能になります。

第三に、生成AIアプリケーションの開発です。

データプラットフォーム上のアプリケーション開発機能やAI機能を使用して、RAG(Retrieval-Augmented Generation)や生成AIアプリケーションを開発できます。社内データを活用した質問応答システムや、ドキュメント生成システムなど、実用的なアプリケーションを迅速に構築できます。

第四に、自然言語での対話によるデータ活用です。

ビジネスインテリジェンスサービスとデータプラットフォームのプラグインを使用して、自然言語でデータから洞察を得て行動を起こすことができます。

SQLを書くことなく、日常的な言葉でデータを問い合わせ、分析結果を得られることで、非技術者でもデータドリブンな意思決定が可能になります。

AIエージェントプラットフォームの進化

最新のAIエージェントプラットフォームは、あらゆるフレームワークとモデルを使用して、安全かつ大規模にエージェントを構築、デプロイ、運用するための包括的な機能を提供します。

ツールとメモリでエージェントを強化し、ゲートウェイとランタイムで安全にデプロイし、包括的なオブザーバビリティでパフォーマンスを監視・改善できます。

オープンソースフレームワークとの互換性も重要です。主要なオープンソースフレームワークや独自のエージェント開発キットをサポートすることで、開発者は使い慣れたツールを活用しながら、エンタープライズグレードの機能を利用できます。また、新しいプロトコルへの対応により、異なるシステム間でのエージェント連携も容易になっています。

データプラットフォームとAIサービスの連携

データプラットフォーム上のAI機能とクラウドAIサービスを連携させることで、強力なAIエージェントソリューションを構築できます。構造化データに対する分析機能と、非構造化データに対する検索機能を組み合わせることで、包括的なデータ活用が実現します。

ユーザーからの問い合わせに対して、AIエージェントがデータプラットフォーム上の構造化データと非構造化データの両方を検索し、最適な回答を生成できます。さらに、クラウドAIサービスの基盤モデルを活用することで、高度な自然言語理解と生成が可能になります。このような統合アプローチにより、企業は既存のデータ資産を最大限に活用しながら、最新のAI技術の恩恵を受けることができます。

データ戦略とAI戦略の統合

データ戦略なくしてAI戦略は存在しない

生成AIの価値を最大化するためには、AI戦略とデータ戦略を統合的に推進することが不可欠です。

どれだけ優れたAIモデルを導入しても、そのモデルに入力するデータの品質が低ければ、期待する成果は得られません。「データ基盤戦略なくしてAI戦略、AXは実現しない」という原則を、企業は改めて認識する必要があります。

データ戦略の核心は、AIやアプリケーションであらゆるデータからセキュアに価値を得るための包括的な計画を策定することです。

データの収集、統合、保存、処理、ガバナンス、セキュリティ、活用までの一連のプロセスを設計し、組織全体で一貫したデータ管理を実現する必要があります。

信頼できるデータ基盤がもたらす競争優位性

信頼できるデータ基盤を構築することで、企業は複数の競争優位性を獲得できます。

第一に、意思決定の質とスピードが向上します。

リアルタイムで正確なデータにアクセスできることで、市場の変化に迅速に対応し、競合他社に先んじた施策を実行できます。

第二に、イノベーションの加速です。

データサイエンティストや開発者が、データの準備や品質管理に時間を取られることなく、新しいAIモデルやアプリケーションの開発に集中できます。実験と検証のサイクルが短縮されることで、市場投入までの時間が大幅に短縮されます。

第三に、リスク管理の強化です。

適切なガバナンスとセキュリティが確保されたデータ基盤により、コンプライアンス違反や情報漏洩のリスクを最小化できます。また、AIモデルの判断根拠を追跡可能にすることで、説明責任を果たし、ステークホルダーからの信頼を獲得できます。

第四に、コスト効率の改善です。

データの重複保持や無駄な処理を排除し、データの精度があがることによって、AIエージェントとのやりとりの回数が減ることは全体的なトークン量も大きく下げることが可能となります。

必要なリソースのみを使用することで、インフラコストやAI使用コストを最適化できます。

また、自動化により人的リソースの効率的な配分が可能になり、組織全体の生産性が向上します。

【関連情報】

CDP活用の具体的な方法については、こちらのガイド資料が参考になります

まとめ – 生成AI時代のデータ基盤構築のポイント

本記事では、信頼できるデータが生み出す生成AIの価値について、データ基盤の重要性、具体的なユースケース、AIエージェントの進化、そしてデータ戦略とAI戦略の統合という観点から解説してきました。最後に、生成AI時代のデータ基盤構築における重要なポイントをまとめます。

データの民主化、データ連携柔軟性、データガバナンスの3要素を確保

データ基盤には、使いやすさ、つながる力、信頼性という3つの要素が不可欠です。

AI活用に最適なプラットフォームの構築により運用負荷を最小化し、強力なシェアリング機能で組織内外のコラボレーションを促進し、エンタープライズグレードのセキュリティとガバナンスで信頼性を確保することが重要です。

これらの要素をバランスよく実現することで、技術者だけでなくビジネスユーザーも含めた組織全体でのデータ活用が可能になります。

クラウドプラットフォームとの深い統合

データ基盤は、クラウドプラットフォームの豊富なサービスと深く統合されている必要があります。データ取り込みから、処理、分析、機械学習、生成AIまでの一連のパイプラインを、クラウド上でシームレスに構築できることが、現代のデータ基盤の必須要件です。

多数のサービスとの統合により、企業は最適なツールを組み合わせて、自社のビジネス要件に最適なソリューションを構築できます。

構造化・非構造化データの統合活用

生成AI活用においては、構造化データだけでなく、テキスト、画像、音声、動画などの非構造化データも重要な価値を持ちます。これらの多様なデータ形式を統合的に扱える基盤を構築することで、より豊かなAIアプリケーションの開発が可能になります。ドキュメント処理、埋め込みモデル、ベクトル検索などの機能を統合し、非構造化データからも価値を引き出せる環境を整備することが重要です。

AIエージェントによる自律化の推進

AIの進化は、単なるアシスタントから自律的なエージェントへと向かっています。人間の監視を最小限に抑えながら、複雑な業務プロセスを遂行できるAIエージェントを安全かつ大規模に運用できる基盤が求められます。ツール、メモリ、ゲートウェイ、ランタイム、オブザーバビリティなどの包括的な機能を提供するプラットフォームにより、エンタープライズグレードのAIエージェントソリューションを実現できます。

データ戦略とAI戦略の一体的推進

最も重要なのは、データ戦略とAI戦略を別々のものとして扱うのではなく、一体的に推進することです。AIの価値は、その基盤となるデータの品質に大きく依存します。データの収集、保存、処理、ガバナンス、セキュリティを包括的に管理し、AI活用のための最適な環境を整備することが、生成AI時代における企業の競争力を左右します。

おわりに

生成AIは、企業のビジネスモデルや業務プロセスを根本から変革する可能性を秘めています。しかし、その価値を最大限に引き出すためには、信頼できるデータ基盤が不可欠です。使いやすく、つながり、信頼できるデータ基盤を構築することで、企業は生成AIの真の価値を実現できます。

本記事で紹介した、顧客体験の向上、従業員の生産性向上、ビジネスプロセスの最適化、AIエージェントによる自律化など、多様なユースケースは、すでに多くの企業で実践され、成果を上げています。データ戦略とAI戦略を統合的に推進し、組織全体でデータドリブンな文化を醸成することが、生成AI時代における成功の鍵となるでしょう。

データ基盤の構築や生成AI活用にご興味をお持ちの企業は、ぜひ本記事で紹介した考え方を参考に、自社のデータ戦略とAI戦略を見直してみてください。信頼できるデータが、信頼できるAIを生み出し、それが企業の持続的な成長と競争優位性の源泉となります。

CDP/DWHを活用したデータドリブン経営の実現、生成AI技術との融合による新たな価値創出にご興味をお持ちの方は、ぜひお気軽にお問い合わせください。貴社の課題やニーズに合わせた最適なソリューションをご提案いたします。

製品サイト:https://cx.geniee.co.jp/product/cdp/

AI基盤比較資料:https://geniee.co.jp/media/ebook/ai-platform-hikaku/

CDP活用ガイド:https://geniee.co.jp/media/ebook/gl-cdp-ebook001/