AI時代の競争力を高める「安全性とガバナンス」のデータ活用実践

この記事で分かること

- AI導入における「WHY・WHAT・HOW」3ステップアプローチ

- AIリスクの分類と企業が直面する技術的・社会的リスクへの対処法

- リスクベースのAIガバナンス体制構築の具体的手法

- データ資産管理とアクセス制御による競争優位性の確立

- AI時代のビジネスプロセス再設計と継続的進化への対応策

生成AIの急速な普及により、企業のDX推進は新たな局面を迎えています。しかし、AI導入を急ぐあまり、安全性やガバナンスの観点が軽視されるケースが散見されます。技術的な可能性に目を奪われ、リスク管理が後回しになることで、企業は重大なレピュテーションリスクや法的リスクに直面する可能性があります。

本記事では、政府のAI安全性に関する取り組みを参考にしながら、企業がAI導入時に考慮すべき安全性とガバナンスの実践的なアプローチをご紹介します。経営層からシステム部門、DX推進担当者まで、AI活用を検討する全ての方に向けて、リスクを適切に管理しながらイノベーションを推進する方法を詳しく解説いたします。

AI導入の前に問うべき3つの本質的な質問

多くの企業が「AI導入」を経営課題として掲げていますが、その前に立ち止まって考えるべき本質的な問いがあります。それは「WHY・WHAT・HOW」という3段階のアプローチです。

展示会などに立って来場者の話を聞いてみると、経営層からトップダウンで「とにかくAIをいついつまでに導入を!」という号令が下りAI関連のツールを探しに来たというDX推進部署の担当者が非常に多いことがわかります。そこには前述した「WHY・WHAT・HOW」が一切抜け落ちており、AI導入自体が目的化してしまっている状態です。投資対効果が不明確なまま予算が消費され、結果として期待した成果が得られないことから失敗に終わるという事態に陥ります。

なぜAIを使うのか:目的の明確化が最重要

第一の問いは「なぜAIを使うのか」です。これは3つの問いの中で最も重要な要素となります。

AIを導入する目的は、大きく分けて2つのパターンがあります。1つは業務効率化、もう1つは新規事業創出です。この目的が明確でなければ、後続の「WHAT」「HOW」は定まりません。

業務効率化を目指すのであれば、どの業務プロセスのどの部分をAIに転化し効率化するのかを具体的に特定する必要があります。

新規事業創出であれば、AIによってどのような価値を顧客に提供するのかを明確にしなければなりません。

重要なのは、この目的設定を経営層だけでなく、現場の実務担当者も含めて共有することです。目的が共有されていない状態でAI導入を進めると、各部門がバラバラの方向を向いてしまい、組織全体としての成果につながりません。

何をするのか:具体的なビジネス課題の特定

第二の問いは「何をするのか」です。

目的が明確になれば、具体的に取り組むべき課題が見えてきます。

例えば、業務効率化が目的であれば、カスタマーサポートの応答時間短縮、契約書レビューの自動化、マーケティング施策の最適化など、具体的な業務プロセスを特定します。新規事業創出であれば、AIを活用した新サービスの内容や、既存サービスの高度化の方向性を定義します。

ここで注意すべきは、「データから作る」というアプローチを避けることです。手元にあるデータを見て「このデータで何かできないか」と考えるのは、本末転倒です。まず解決すべきビジネス課題を特定し、その課題解決に必要なデータは何かを逆算して考えるべきです。

この順序を間違えると、データはあるが活用できない、あるいは不要なデータ収集に時間とコストを費やすという事態に陥ります。

どのように実装するか:データ品質が成否を分ける

第三の問いは「どのように実装するか」です。ここで最も重要になるのがデータの品質です。

質の悪いデータを入力すれば、質の悪い結果しか出力されないというのはあたりまえのことであり、AIの性能は、AIに最適化されたデータ基盤の介在有無と学習データの品質に大きく依存します。どれほど高度なアルゴリズムを使用しても、データが整理されておらず、AIが読み込みしやすい状態になっていなければ、AIの出力精度も低下します。

しかし、全てのデータを完璧に整備することは現実的ではありません。重要なのは、目的に応じて必要なデータの品質を確保することです。目的が明確であれば、どのデータの品質を優先的に高めるべきかが自然と定まります。

また、データ品質は一度確保すれば終わりではありません。ビジネス環境の変化に伴い、データも変化します。継続的にデータ品質を維持・向上させる仕組みを構築することが、AI活用の成功には不可欠です。

これら3つの問いは、順番に進めるのではなく、同時並行で検討することが推奨されます。どれか1つだけを先行させると、他の要素との整合性が取れなくなるリスクがあります。

AIに最適化されたデータ基盤の構築や比較については、こちらの資料も参考にしてください。

AIリスクの全体像:技術的・社会的・企業固有のリスク

AI導入には大きな可能性がある一方で、新たなリスクも伴います。これらのリスクを適切に理解し、管理することが、持続可能なAI活用の前提条件となります。

AIのリスクは、大きく3つのカテゴリーに分類されます。技術的リスク、社会的リスク、そして企業固有のリスクです。それぞれのリスクの特性を理解し、適切な対策を講じることが求められます。

技術的リスク:ハルシネーション、判定エラー、バイアス

技術的リスクとは、AI技術そのものに起因するリスクです。

第一に、ハルシネーション(幻覚)があります。これは、AIが根拠のない情報を、あたかも事実であるかのように生成する現象です。生成AIは、学習データに基づいて確率的に文章を生成するため、存在しない情報を創作してしまうことがあります。特に、専門的な知識が必要な分野や、最新の情報が求められる場面で発生しやすい傾向があります。

第二に、判定エラーがあります。AIによる分類や予測が誤っている場合です。例えば、画像認識AIが製品の不良品を見逃す、与信審査AIが返済能力のある顧客を誤って拒否するなどのケースが該当します。

第三に、バイアス(偏り)があります。これは、学習データに含まれる偏りがAIの判断に反映される現象です。過去の採用データを学習したAIが、特定の属性を持つ候補者を不当に低く評価してしまうという事例が報告されています。歴史的に存在した差別や偏見が、AIによって再生産されるリスクがあるのです。

これらの技術的リスクは、完全に排除することは困難ですが、適切な検証プロセスを設けることで軽減できます。AIの出力を人間が確認する仕組み、定期的な精度検証、多様なデータセットの活用などが有効な対策となります。

社会的リスク:プライバシー、悪用、権力集中、環境負荷

社会的リスクとは、AI技術が社会全体に及ぼす影響に関するリスクです。

第一に、プライバシー侵害のリスクがあります。AIは大量の個人データを処理することで高い性能を発揮しますが、その過程で個人のプライバシーが侵害される可能性があります。特に、複数のデータソースを組み合わせることで、個人を特定できてしまうリスクがあります。

第二に、悪用のリスクがあります。ディープフェイク技術を用いた偽情報の拡散、AIを活用した詐欺行為、政治的な世論操作など、AI技術が悪意ある目的で使用される可能性があります。技術の進歩により、これらの悪用手法も高度化しています。

第三に、権力集中のリスクがあります。高度なAI技術を保有する企業や国家に権力が集中し、格差が拡大する可能性が指摘されています。AI技術へのアクセスが不平等であることが、社会的な不平等を助長する懸念があります。

第四に、環境負荷のリスクがあります。大規模なAIモデルの学習や運用には、膨大な電力と水資源が必要です。AIが1回の回答を生成するために、ペットボトル1本分の水が必要になるという試算もあります。AI活用の拡大が、環境問題を悪化させる可能性があるのです。

これらの社会的リスクに対しては、企業単独での対応には限界があります。業界全体での自主規制、政府による法規制、国際的な協調など、多層的なアプローチが必要となります。

企業固有のリスク:レピュテーションリスクの重大性

企業固有のリスクとして特に重要なのが、レピュテーションリスクです。

レピュテーションリスクとは、企業の評判や信頼が損なわれるリスクです。AIの判断や出力が、法律には違反していなくても、社会的に受け入れられない結果をもたらした場合、企業の信頼は大きく損なわれます。

例えば、AIによる顧客対応が不適切だった、AIの判断が特定の顧客層を不当に扱っていた、AIが生成したコンテンツが不適切だったなどのケースが該当します。これらは必ずしも法律違反ではありませんが、SNSなどで拡散されることで、企業のブランドイメージに深刻なダメージを与える可能性があります。

レピュテーションリスクの特徴は、発生してからの対応が極めて困難であることです。一度失われた信頼を回復するには、長い時間と多大なコストが必要になります。そのため、事前の予防が何よりも重要となります。

予防策としては、AIの出力を公開する前に複数の視点から検証する、多様なステークホルダーの意見を取り入れる、問題が発生した際の対応プロセスを事前に整備するなどが有効です。

CDP活用の詳細については、こちらの製品サイトも参照してください。

リスクベースのAIガバナンス体制構築

AIのリスクを適切に管理するためには、リスクベースのガバナンス体制を構築することが不可欠です。全てのAI活用に同じレベルの厳格な管理を適用するのは非効率であり、イノベーションを阻害します。リスクの大きさに応じて、適切なレベルの管理を行うことが重要です。

政府のAI事業者ガイドラインでは、従来の「AI原則を守ります」という宣言から、「AIガバナンス」を示す方向へと転換しています。つまり、実際の体制やプロセスを明確にし、それを公開することが求められているのです。

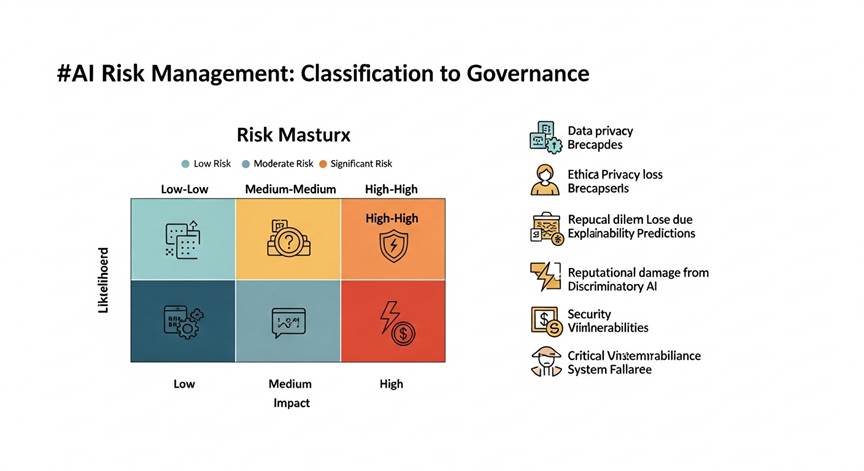

AIサービスの分類とリスク評価マトリックス

ある自治体の事例では、AIサービスを3つのカテゴリーに分類しています。

第一に、市民向けサービスです。これは最も慎重な対応が求められます。市民のリテラシーは多様であり、AIの限界を理解していない利用者も多く存在します。また、公共サービスという性質上、レピュテーションリスクが非常に高くなります。

第二に、職員向けサービスです。これは中程度のリスクレベルとなります。職員は一定のリテラシーを持っており、AIの限界も理解しています。ただし、職員の判断が市民に影響を及ぼす可能性があるため、一定の管理は必要です。

第三に、職員内部のみで使用するサービスです。これは比較的自由度を高く設定できます。外部への影響が限定的であり、イノベーションを重視した運用が可能です。

さらに、リスク評価マトリックスを活用することで、より詳細なリスク管理が可能になります。縦軸にデータの機密度(公開情報から機密情報まで)、横軸に利用者の範囲(全社から限定的まで)を設定し、各セルごとにリスクレベルを設定します。

例えば、機密度の高いデータを広範囲の利用者が使用する場合は「赤(高リスク)」、公開情報を限定的な利用者が使用する場合は「緑(低リスク)」といった具合です。このマトリックスに基づいて、それぞれのリスクレベルに応じた管理策を適用します。

高リスクの領域では、厳格な承認プロセス、定期的な監査、詳細なログ記録などを実施します。低リスクの領域では、簡易な承認プロセスで迅速な導入を可能にし、イノベーションを促進します。

政府ガイドラインに基づく共通指針

政府のAI事業者ガイドラインでは、7つの共通指針が示されています。

第一に、人間中心の原則です。AIのためのAIではなく、人間のためのAIであることを常に意識する必要があります。AI導入の目的は、人間の生活や業務を向上させることであり、AI技術の追求自体が目的ではありません。

第二に、安全性・公平性・プライバシー保護です。AIの判断が安全であること、特定の属性による不当な差別がないこと、個人のプライバシーが保護されることが求められます。

第三に、セキュリティ確保です。AI特有のセキュリティリスク(敵対的攻撃、モデルの盗用など)に対応する必要があります。従来のITセキュリティとは異なる観点での対策が必要です。

第四に、透明性・アカウンタビリティです。AIがどのように判断しているのか、その運用方法を明確に説明できることが重要です。ブラックボックス化を避け、説明責任を果たせる体制を整備します。

第五に、教育・リテラシー向上です。AI利用者のリテラシーを高めることで、適切な活用と誤用の防止を図ります。

第六に、イノベーション推進です。リスク管理を重視しつつも、過度な規制によってイノベーションを阻害しないバランスが求められます。

第七に、公正競争の確保です。AI技術へのアクセスが特定の企業に偏らないよう、公正な競争環境を維持します。

これらの指針を自社の状況に合わせて具体化し、実際の運用プロセスに落とし込むことが、実効性のあるガバナンス体制の構築につながります。

データ資産管理とアクセス制御の戦略的重要性

AI時代において、データは「人・物・金」に次ぐ第4の経営資源として認識されるべきです。しかし、多くの企業では、データの所在や品質、アクセス権限が不明確なまま放置されているのが実態です。

経営層が「自社にどのようなデータがあるか」を明確に答えられるレベルまで、データ資産の可視化と管理を進めることが、AI活用の成功には不可欠です。

データのロック・アンロックバランス

データ管理において重要な概念が「データのロック・アンロック」です。

保護されすぎたデータは活用できません。厳格なアクセス制限により、本来活用できるはずのデータが使えない状態になっていることがあります。これは、データという資産を持ちながら、その価値を引き出せていない状態です。

一方で、完全に開放するのも危険です。機密情報や個人情報が不適切に利用されれば、重大なセキュリティインシデントやプライバシー侵害につながります。

重要なのは、リスクベースで適切にアクセス制御を行うことです。データの機密度、利用目的、利用者の権限などを総合的に判断し、必要な範囲でデータへのアクセスを許可します。

具体的には、データカタログを整備し、どのようなデータが存在するのかを可視化します。各データに対して、機密度レベルを設定し、アクセス権限を明確に定義します。そして、定期的にアクセスログを監査し、不適切な利用がないかを確認します。

また、AIエージェントごとにアクセス権を設定することも重要です。全てのAIが全てのデータにアクセスできる状態は避けるべきです。AIの用途に応じて、必要最小限のデータへのアクセスのみを許可します。

データ整理の重要性

データ管理は、机の上の整理に例えることができます。

机が散らかっていると、必要な書類を探すのに時間がかかり、仕事の効率が低下します。同様に、データが整理されていないと、必要なデータを見つけられず、AI活用の効率が低下します。

逆に、机が整理されていれば、必要な書類をすぐに取り出せ、仕事がスムーズに進みます。データが整理されていれば、AIが必要なデータに迅速にアクセスでき、高い性能を発揮できます。

さらに、整理された机は、重要な書類の紛失を防ぎます。整理されたデータ環境は、セキュリティリスクの低減にもつながります。どこにどのデータがあるかが明確であれば、不正アクセスや情報漏洩のリスクを早期に検知できます。

データ整理の具体的な手順としては、まず現状のデータ資産を棚卸しします。どこにどのようなデータが存在するのかを把握します。次に、データの重要度や機密度に応じて分類します。そして、不要なデータは削除し、必要なデータは適切な場所に保管します。

この整理作業は一度行えば終わりではありません。ビジネスの変化に伴い、新しいデータが生成され、既存のデータの重要度も変化します。定期的にデータの棚卸しと整理を行う仕組みを構築することが重要です。

マーケティング基盤の最適化については、こちらの資料も参考になります:

AI時代のビジネスプロセス再設計と継続的進化

AI技術の進化は日進月歩です。新しいモデルやサービスが次々と登場し、その性能も急速に向上しています。この進化にどう対応していくかは、多くの企業が直面する課題です。

しかし、全ての進化にキャッチアップすることは不可能であり、また必要でもありません。重要なのは、自社のビジネスに関連する領域に絞って、戦略的に進化に対応することです。

効率性・新規性・固有性の3つの観点

AI技術を評価する際には、3つの観点が有効です。

第一に、効率性です。AIによって既存の業務プロセスがどれだけ効率化されるかを評価します。処理時間の短縮、コストの削減、品質の向上などが指標となります。

第二に、新規性です。AIによってこれまで不可能だったことが可能になるか、新しい価値を創出できるかを評価します。新規事業の創出、新サービスの提供、顧客体験の革新などが該当します。

第三に、固有性です。自社らしさをどう追求するかという観点です。AIの機能自体では差別化できません。誰もが同じモデルやサービスを利用できるからです。差別化の源泉は、自社の事業内容とAIをどう組み合わせるかにあります。

自社の強みや独自性を理解し、それをAIでどう強化・拡大するかを考えることが、競争優位性の確立につながります。

プライベート活用で肌感覚を養う

AI技術の進化を理解する最も効果的な方法は、自分自身で使い倒すことです。

ニュース記事や技術レポートを読むだけでは、AIの真の能力や限界を理解することはできません。実際に使ってみることで、どのような場面で有効か、どのような限界があるかを肌感覚で理解できます。

例えば、生成AIの新しいバージョンがリリースされたら、実際に使ってみて前バージョンとの違いを体感します。どのような質問に対する回答が改善されたか、どのような新機能が追加されたかを確認します。

この肌感覚は、ビジネスでの活用を検討する際に非常に重要です。技術仕様だけでは判断できない、実用性や使い勝手を評価できるからです。

また、プライベートでの活用は、失敗のコストが低いという利点もあります。ビジネスで導入する前に、様々な使い方を試行錯誤し、ノウハウを蓄積できます。

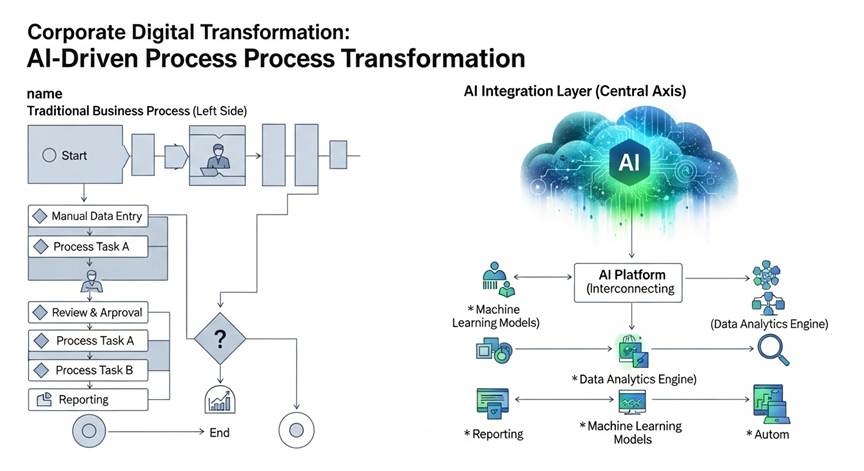

既存プロセスへの組み込みではなく、プロセスの再設計を

AI導入において最も重要なのは、既存のビジネスプロセスにAIを組み込むのではなく、AI時代に最適なプロセスを再設計することです。

既存プロセスにAIを組み込むアプローチでは、AIの潜在能力を十分に引き出せません。既存プロセスは、AIが存在しない時代に最適化されたものだからです。

例えば、カスタマーサポートにAIを導入する場合を考えます。既存のプロセスにAIチャットボットを追加するだけでは、限定的な効果しか得られません。

一方、プロセス全体を再設計するアプローチでは、AIが一次対応を行い、複雑な問い合わせのみを人間が対応する、AIが過去の対応履歴を分析して最適な回答を提案する、AIが顧客の感情を分析してエスカレーションの判断を支援するなど、プロセス全体が変革されます。

このプロセス再設計には、全社的な取り組みが必要です。特定の部門だけでは完結しません。経営層のコミットメント、部門横断的な協力、従業員の意識改革などが求められます。

また、プロセス再設計は一度行えば終わりではありません。AI技術の進化、ビジネス環境の変化に応じて、継続的に見直しと改善を行う必要があります。

まとめ:安全性とガバナンスが切り拓くAI時代の競争力

AI技術は、企業に無限の可能性をもたらします。業務効率化、新規事業創出、顧客体験向上など、様々な領域で活用できます。しかし同時に、新しいリスクも伴います。

重要なのは、リスクを恐れてAI導入を躊躇することではなく、リスクを適切に管理しながらイノベーションを推進することです。安全性とガバナンスは、AI活用を阻害する障壁ではなく、持続可能なAI活用を実現するための基盤なのです。

本記事で紹介した「なぜ・何を・どのように」の3段階アプローチ、リスクベースのガバナンス体制、データ資産管理、ビジネスプロセス再設計は、いずれも実践的な手法です。自社の状況に合わせてカスタマイズし、段階的に導入することで、AI時代の競争力を高めることができます。

AI導入は、もはや選択肢ではなく必須要件です。しかし、闇雲に導入するのではなく、慎重に検討し、適切に管理することが求められます。事業課題から出発し、AIのロールを明確にし、継続的に進化に対応する。この基本を忠実に実行することが、AI時代の成功への道筋となります。

DX推進部署やシステム部門の責任者の皆様にとって、本記事が自社のAI戦略を検討する際の参考となれば幸いです。AI導入やガバナンス体制の構築について、さらに詳しい情報をお求めの方は、ぜひ以下のリソースをご活用ください。

AI導入やデータ活用戦略について、さらに詳しい情報をご希望の方は、以下のリソースをご活用ください。

CDP製品サイト

AI基盤比較資料

CDP活用ガイド

貴社のDX推進に向けて、専門スタッフが最適なソリューションをご提案いたします。お気軽にお問い合わせください。